La génération de texte, d’images ou de code par intelligence artificielle est désormais largement démocratisée. En 2025, une nouvelle étape est franchie avec l’intégration de Lyria 3 au sein de Gemini, le modèle multimodal développé par Google. Cette évolution permet désormais de générer des morceaux musicaux à partir d’instructions textuelles ou visuelles, directement depuis l’interface de Gemini. Le déploiement initial s’effectue sur ordinateur, avec une extension progressive vers d’autres environnements. L’objectif est clair : étendre les capacités multimodales de l’IA à la composition musicale, en simplifiant radicalement l’accès à la création sonore.

Cette avancée s’inscrit dans un contexte où le marché mondial de la musique générée par IA connaît une croissance rapide. Selon un rapport de MarketsandMarkets publié en 2023, le secteur de l’IA appliquée aux industries créatives pourrait dépasser 10 milliards de dollars d’ici 20301. La musique figure parmi les segments les plus dynamiques, portée par les besoins croissants en contenus audio personnalisés pour les plateformes numériques.

Lyria 3 : un modèle de génération musicale contrôlée

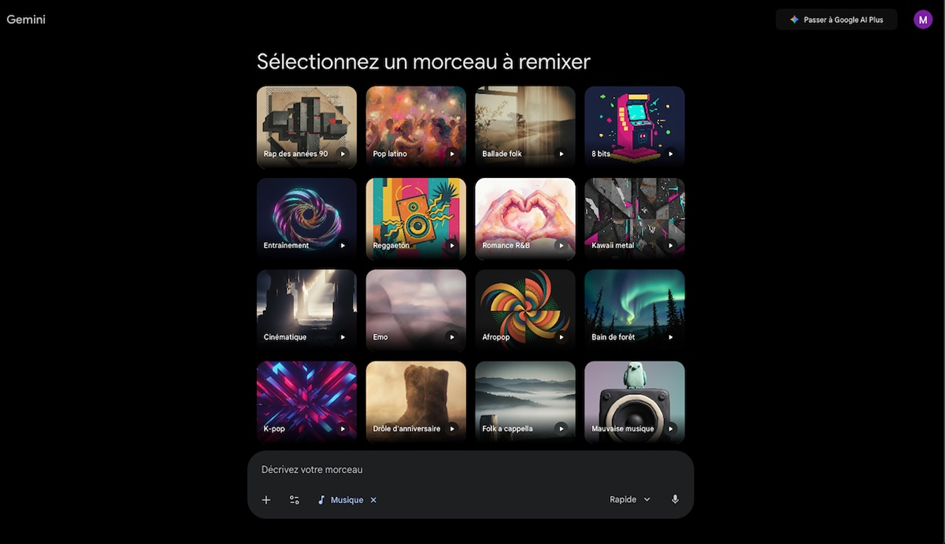

Lyria 3 est conçu pour produire des compositions d’environ trente secondes à partir d’un simple prompt décrivant une ambiance, un genre, un rythme ou une situation précise. L’utilisateur sélectionne l’option dédiée à la création musicale dans Gemini, formule sa demande, puis le système génère un morceau complet intégrant instrumentation, structure rythmique et parfois des éléments vocaux synthétiques.

Techniquement, cette capacité repose sur des architectures de modèles génératifs entraînés sur de vastes corpus musicaux. Comme pour les modèles texte vers image, le système apprend des régularités stylistiques, harmoniques et structurelles afin de produire des séquences audio cohérentes. L’approche multimodale permet également d’utiliser une image comme point d’entrée, l’IA traduisant des caractéristiques visuelles en ambiance sonore correspondante.

Les premiers retours d’usage mettent en avant la rapidité d’exécution et la simplicité de prise en main. Une seule instruction textuelle suffit à déclencher la génération. Toutefois, des limites subsistent, notamment lors de requêtes complexes combinant plusieurs styles ou contraintes rythmiques précises. Cette phase de maturation est classique dans le cycle d’amélioration des modèles génératifs.

Des usages concrets pour les créateurs et les plateformes

L’intégration de Lyria 3 dans Gemini ouvre plusieurs cas d’usage concrets.

- Création de jingles et musiques courtes pour les vidéos en ligne

- Génération de bandes-son personnalisées pour des contenus courts

- Prototypage musical rapide pour des projets créatifs

- Expérimentation pédagogique autour de la composition assistée par IA

- Production de contenus audio personnalisés pour applications numériques

Lyria 3 est également connecté à l’écosystème YouTube via Dream Track, permettant aux créateurs de générer des musiques adaptées au thème de leurs vidéos courtes. Cette interconnexion entre IA générative et plateforme de diffusion renforce la cohérence stratégique de l’écosystème numérique.

Selon l’IFPI, plus de 120 000 nouveaux morceaux sont publiés chaque jour sur les plateformes de streaming en 20242. Dans ce contexte d’hyperproduction, la capacité à générer rapidement des contenus sonores personnalisés devient un levier stratégique pour les créateurs indépendants et les entreprises de contenus numériques.

Une créativité augmentée plutôt qu’une production de studio

Il est important de souligner que les morceaux générés ne visent pas à rivaliser avec des productions musicales de studio. L’objectif est davantage de proposer une couche sonore personnalisée, adaptée à des usages quotidiens ou à des formats courts. La valeur ajoutée réside dans l’instantanéité et la personnalisation, non dans la sophistication artistique comparable à celle d’un compositeur professionnel.

Cette logique correspond à une tendance plus large observée dans l’IA générative : l’outil devient un accélérateur d’expression créative plutôt qu’un substitut direct aux professionnels. Une étude du MIT publiée en 2023 montre que les outils d’IA créative augmentent la productivité des utilisateurs non experts de 37 %, tout en maintenant un rôle central pour l’expertise humaine dans les productions complexes3.

Droits d’auteur, traçabilité et responsabilité

La génération musicale soulève immédiatement des questions juridiques et éthiques. Les modèles sont entraînés sur d’importants corpus musicaux, ce qui interroge la question de l’inspiration, de la reproduction de styles et de la protection des ayants droit.

Pour répondre à ces enjeux, Google intègre à Lyria 3 un filigrane numérique appelé SynthID, déjà utilisé pour les images générées par IA. Ce marquage imperceptible permet d’identifier l’origine artificielle d’un contenu audio. L’utilisateur peut également analyser un fichier pour vérifier la présence de ce marquage.

La question de la traçabilité est centrale. Le Parlement européen, dans le cadre de l’AI Act adopté en 2024, insiste sur la nécessité d’identifier clairement les contenus générés par intelligence artificielle afin de préserver la transparence et la confiance des utilisateurs4. L’intégration d’un filigrane constitue une réponse technique, mais son efficacité dépendra de sa robustesse face aux modifications ou aux traitements ultérieurs des fichiers audio.

Un autre point concerne l’interprétation des prompts mentionnant des artistes connus. Les modèles sont conçus pour éviter l’imitation directe et privilégier des inspirations stylistiques générales. Des mécanismes de filtrage et de signalement visent à limiter les abus potentiels.

Vers une IA créative intégrale

L’intégration de Lyria 3 illustre une tendance structurante : la convergence des modalités au sein d’une même plateforme. Texte, image, vidéo et désormais musique sont générés dans un environnement unifié. Cette intégration renforce la cohérence des écosystèmes numériques et simplifie l’expérience utilisateur.

À moyen terme, cette évolution pourrait transformer la manière dont les contenus multimédias sont conçus. Un créateur pourrait générer simultanément scénario, visuels et bande-son au sein d’un même flux de travail assisté par IA. Selon PwC, l’automatisation créative pourrait contribuer à une augmentation de productivité significative dans les industries culturelles d’ici 20305.

Reste une question centrale : si composer devient aussi accessible que rédiger un texte ou générer une image, comment redéfinir la notion d’auteur et de valeur artistique dans un environnement où la création est instantanée et largement automatisée ?

Vers une hybridation structurelle entre compositeurs et algorithmes

Lyria 3 dans Gemini marque une nouvelle étape dans l’extension des capacités multimodales de l’intelligence artificielle. La génération musicale sur demande simplifie l’accès à la création sonore, tout en soulevant des enjeux juridiques et éthiques majeurs. L’outil s’inscrit dans une logique d’augmentation créative plutôt que de substitution artistique. La question qui se pose désormais est celle de l’équilibre entre démocratisation technologique et reconnaissance de la valeur humaine dans l’acte de composition.

Précédemment sur ce blog, nous avons analysé l’essor des modèles multimodaux avec « ChatGPT passe à la vitesse supérieure : OpenAI dévoile GPT-5 », ainsi que l’impact des technologies génératives sur les industries créatives dans « Meta x Midjourney : une alliance stratégique pour révolutionner l’image et la vidéo IA ». Ces évolutions montrent que la musique n’est qu’une étape supplémentaire dans l’intégration globale de l’IA au cœur des processus créatifs.

Comment fonctionne Lyria 3 ?

Lyria 3 repose sur une architecture de modèles génératifs audio entraînés sur de vastes corpus musicaux annotés. Le système s’appuie sur des réseaux neuronaux profonds capables de modéliser les structures harmoniques, rythmiques et spectrales d’un morceau afin de produire une séquence audio cohérente à partir d’une instruction textuelle ou visuelle.

L’intégration dans Gemini s’appuie sur une logique multimodale : le prompt textuel ou l’image fournie est d’abord encodé dans un espace latent partagé. Ce vecteur sémantique est ensuite transmis au module audio, qui génère une représentation spectrogramme avant conversion en signal sonore exploitable.

- Modèles de diffusion audio ou architectures autoregressives adaptées au signal temporel

- Encodage multimodal texte / image vers espace latent unifié

- Génération de spectrogrammes puis reconstruction du signal audio

- Optimisation par apprentissage auto-supervisé sur grands corpus musicaux

- Intégration d’un filigrane numérique (SynthID) directement dans le signal

- Durée limitée des morceaux (environ 30 secondes) pour maîtriser la complexité computationnelle

- Filtrage des requêtes mentionnant des artistes spécifiques afin d’éviter l’imitation directe

- Watermark imperceptible intégré au signal audio pour assurer la traçabilité

- Latence optimisée pour génération quasi instantanée en environnement cloud

- Contrôle probabiliste de cohérence harmonique et rythmique

Pour aller plus loin

L’intégration de Lyria 3 dans Gemini illustre l’élargissement des capacités créatives des modèles multimodaux, capables de générer aussi bien du texte que de la musique ou des images. Sur un sujet complémentaire, découvrez notre article « Nano Banana 2, la future IA de Google qui floute la frontière entre image générée et photo réelle », qui analyse comment les avancées en génération visuelle participent à redéfinir les standards de réalisme et de création assistée par l’intelligence artificielle.

Références

1. MarketsandMarkets. (2023). AI in Media & Entertainment Market Forecast.

https://www.marketsandmarkets.com

2. IFPI. (2024). Global Music Report 2024.

https://www.ifpi.org

3. Brynjolfsson, E., Li, D., Raymond, L. (2023). Generative AI at Work. MIT Sloan Research.

https://mitsloan.mit.edu

4. Parlement européen. (2024). Artificial Intelligence Act.

https://www.europarl.europa.eu

5. PwC. (2023). Sizing the Prize: AI in the Creative Industries.

https://www.pwc.com